生成性人工智能的潜力与挑战

关键要点

生成性人工智能能够极大地推动创新,助力于艺术、科学研究和网络安全等领域。该技术也带来了潜在的误用风险,包括深度伪造、信息失真及社会偏见的加剧。需要采取积极措施以确保技术的负责任发展和合理使用。在近年来,人工智能AI领域取得了显著进展,尤其是生成性人工智能方面。这些生成性AI工具指的是可以生成新内容如文本、图像和音乐的算法和模型,模仿人类的创造力。虽然这项技术带来了令人兴奋的可能性和潜在应用,但同时也引发了关于其影响的担忧与恐惧。那么,我们是否应该对生成性AI感到恐惧呢?

我们需要开始审视生成性AI相关的潜在好处和风险。一方面,生成性AI能够彻底改变行业,增强人类的创造力,同时也对科学研究和创新带来好处。它可以通过提供新思路和灵感来帮助艺术家、设计师和音乐家,生成独特的艺术、音乐和视觉作品。通过增强人类的创造力,生成性AI推动了艺术表达的边界。此外,研究人员还可以利用生成性AI探索复杂数据集,生成假设并进行预测,从而加速药物发现并促使诸如材料科学等领域新材料的设计。

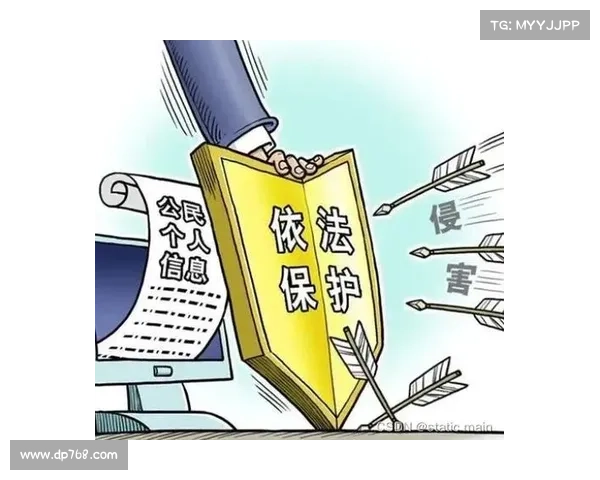

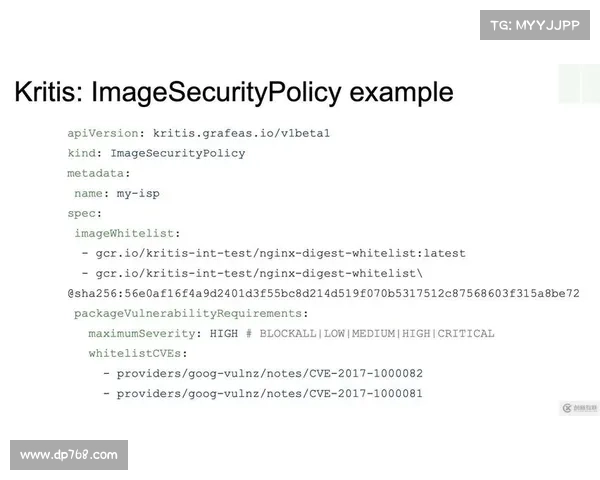

生成性AI在网络安全领域同样展现出显著的潜在益处。随着网络威胁形势的不断演变,传统安全措施往往难以跟上。生成性AI理论上可以通过创建与合法网络流量相似的现实合成数据来增强防御机制,帮助识别和检测异常及潜在入侵。这项技术还可以模拟复杂的攻击场景,使安全专家能够测试和加强他们的系统,以应对新兴威胁。同样,生成性AI也可以在开发强大的身份验证系统方面提供帮助,创建难以复制的生物特征数据,增强面部识别和指纹识别等领域的安全性。

然而,伴随这些有前景的应用,也存在着合法的担忧。其一是对技术被滥用的担忧。攻击者可以利用生成性AI算法制作深度伪造,这些高度逼真的视频或图片可以操控或歪曲信息。这对信息的完整性构成了生存威胁,恶意行为者可以将其用于散布虚假信息、敲诈或政治操控。随着生成性AI的发展,越来越难以区分真实与生成的内容,可能会削弱公众对媒体的信任,并加剧宣传信息的传播。

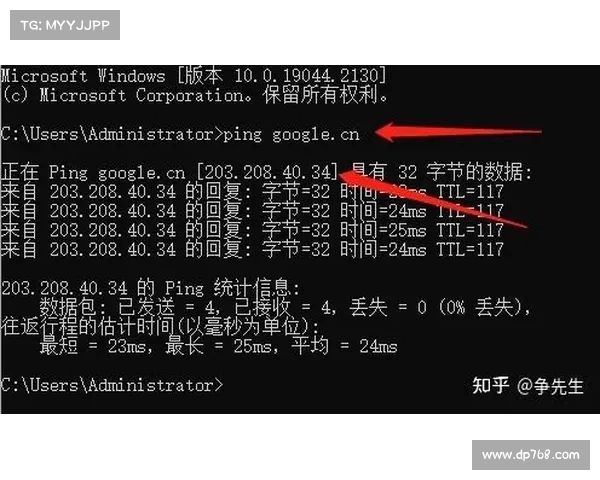

clash verge下载生成性AI同样引发了伦理问题,因为它依赖于偏见的数据集,这导致所产生的内容延续了社会偏见和加深了不平等。此外,还有与职位被取代相关的更广泛社会和经济担忧。随着生成性AI自动化人类之前完成的任务,我们现在确实有理由担心各行业的失业问题。尽管这项技术在长期内可能创造新的就业机会,但我们也可以预见到直接受到影响的人员将在一个艰难的过渡期中挣扎。采取积极措施应对这一挑战,确保生成性AI带来的利益能够公平分配,是十分必要的。

为减少风险并最大化生成性AI的好处,各组织和相关方可以实施以下举措。需要在公众、政策制定者和利益相关者中提升对生成性AI的意识和教育。这将促进有关生成性AI系统负责任发展的讨论和决策。建立清晰的指导方针和规章制度以解决深度伪造、数据偏见和隐私等问题也是非常重要的。

利益相关者应优先考虑透明度和问责制,使算法和模型可解释,让用户理解内容的生成过程,并解决偏见问题。同时,还必须追究开发者的滥用责任。行业在设计和开发过程中必须将伦理考虑纳入其中,策划多样化的训练数据集,并使生成的内容符合伦理标准。公平性、包容性和社会福祉应指导开发过程,研究人员、